Ancaman Deepfake: KBGO dan Gerak Perempuan yang Makin Rentan

“WARNING ada google form revenge porn/ncii + deepfake porn lagi disebarin online,” cuit Indah G, melalui akun pribadinya @itsindahg, pada 24 Juni kemarin.

Kalimat itu jadi pembuka utas yang mengungkap sebuah grup Telegram bernama “Rahasia Mantan”, yang menyebarkan konten pornografi dan gambar intim non-konsensual (non-consensual intimate image atau NCII). Utas yang diunggah di X (Twitter) itu kemudian sempat viral.

Indah bercerita tentang temuannya ini pada saya. Awalnya, Indah dihubungi temannya ‘P’ yang memberi tahu sebuah unggahan teman mereka, ‘S’.

“Hei, sudah lihat unggahannya (S) belum?” kata P kepada Indah.

Dari unggahan S, Indah menemukan Rahasia Mantan yang saat itu sudah punya anggota sekitar 25 ribu. Isinya konten-konten KBGO seperti deepfake porn dan NCII. Konten-konten ini disebarkan secara gratis. Namun, beberapa juga dijual berbayar, khusus untuk para pengikut ‘premium’.

Indah yang kemudian mendapatkan bantuan dari “orang-orang dalam” untuk masuk ke dalam grup itu, melihat bagaimana perempuan diobjektifikasi. Seperti barang atau bahkan makanan, mereka dijejerkan dalam menu yang nanti akan dipilih pengguna agar konten intimnya disebarkan.

“Foto cewek-cewek dipajang. Kayak oh ini menunya nih, kalian mau yang mana terus kalau mau cewek ini, tulis aja namanya, isi di form if you wanna order a specific woman’s NCII,” ujar Indah.

Tak hanya itu, dalam pantauannya melalui formulir daring, pengguna dapat melampirkan foto atau menulis nama akun Instagram perempuan yang ingin mereka jadikan target manipulasi foto. Setelah formulir terkirim, pihak admin akan mengedit foto perempuan yang dimaksud menggunakan teknologi AI untuk menjadikannya konten porno.

Formulir daring ini membuat posisi perempuan jadi lebih rentan. Siapapun bisa jadi korban, tak peduli jika perempuan itu punya konten intim pribadi seperti foto bugil (nudes) atau tidak.

Hal yang sama persis juga pernah terjadi pada 2019 lewat DeepNude dan bot Telegram pada 2020. Keduanya memberikan akses pada para pengguna untuk untuk “menanggalkan” pakaian dari foto-foto perempuan yang ada repositori sumber terbuka.

“Kayak, hei ini Google form yang isinya cewek-cewek yang mau kita strip naked (telanjangi). Kasih nama, IG, dan kampusnya. Random aja. Enggak peduli kamu belum pernah kirim nudes (foto telanjang)—yang mereka kirim pasti bukan nudes kamu juga. Ada teknologi yang bisa bikin foto-foto (telanjang) ini dan bikin kayak realistis banget,” kata Indah pada saya.

Shinta (bukan nama asli), 21, adalah salah satu korban dari grup obrolan Rahasia Mantan. Ditemui Magdalene pada 7 September lalu, Shinta menceritakan pada bulan Juni ia dihubungi oleh salah satu teman media sosialnya (mutuals).

Teman itu diberitahu oleh teman SMA Shinta kalau foto selfie-nya serta data pribadi Shinta termasuk nama lengkap, universitas, dan jurusannya disebar di grup Rahasia Mantan. Informasi itu kemudian disusul dengan keterangan bahwa siapapun yang tertarik melihat koleksi foto bugil Shinta harus mengisi Google Form.

“Aku panik. Aku enggak tau kok mereka bisa punya nude picture or video of me, padahal aku enggak pernah foto nude. So, I suspect it’s AI or edited karena foto selfie aku yang kesebar juga edited. Di situ aku senyum gigi, it’s like you put fake smile filter on me and that original photo was from 4 years ago. Dan di grup itu juga mereka actually shows women yang tadinya pake baju enggak pake baju,” kata Shinta.

Takut foto bugil editan itu tersebar dan membahayakan studi dan keamanannya pribadi, Shinta pun meminta tolong kepada temannya yang kebetulan tergabung dalam Rahasia Mantan sebagai orang dalam untuk meminta admin menurunkan foto Shinta beserta foto bugil editan yang diklaim mereka miliki.

Ternyata usaha ini menemui jalan buntu. Untuk bisa menurunkan Shinta dari “menu” dan menghapus foto bugil editannya, admin Rahasia Mantan meminta teman Shinta mengirimkan foto bugil perempuan lain. Teman Shinta awalnya mengirimkan foto bugil artis porno, tetapi ditolak.

“Mereka bilang yang kamu submit bukan orang asli. They want the actual students di Indonesia. so I can take back mine. Karena persyaratan ini, aku sampai sekarang enggak bisa take down (foto). Yang membuatku takut adalah aku enggak tau siapa dibalik ini dan it could happen in the future ke temen-temenku lain. Beratnya juga I can’t do anything about it,” kata Shinta.

Baca Juga: Magdalene Primer: UU ITE Kriminalisasi Perempuan Korban Pelecehan Seksual

Berasal dari Kecanggihan Teknologi yang Tak Terelakkan

Kehadiran kecerdasan buatan atau kita kenal sekarang dengan AI (Artificial Intelligence) dalam beberapa tahun belakangan ini bisa dibilang jadi idola bagi banyak orang. Kehadirannya jadi gebrakan karena secara efisien membantu dan memudahkan kerja manusia. Di dunia perfilman misalnya seperti yang dikutip dari The Guardian, AI secara signifikan meningkatkan de-aging digital.

Menurut perusahaan AI Metaphysic, berkat AI pertukaran wajah foto realistis beresolusi tinggi dan efek penghilangan usia di atas penampilan para aktor secara langsung dan secara real time bisa dilakukan secara presisi nyaris tanpa atau bahkan tak perlu visual effects (VFX). Ini jelas menghemat tenaga, waktu, serta uang produksi.

Tak hanya di dunia perfilman, AI juga banyak membantu pekerjaan sehari-hari manusia. Lewat AI notulensi rapat atau wawancara bisa langsung ditranskrip dalam hitungan detik. Begitu pula dengan real time translation. AI bisa dengan mudah mengubah ucapan menjadi teks dan teks menjadi bahasa yang berbeda secara real time atau dengan presisi.

Tetapi segala kemudahan yang ditawarkan AI bukan tanpa risiko. Masih ingat tidak dengan video viral Barack Obama yang viral 2018 lalu? Dalam video itu, mantan presiden Amerika Serikat mengumpat dan menyebut Presiden Donald Trump “total and complete dips— “.

Tak berapa lama setelah viral, terungkap bahwa ternyata Obama tidak mengucapkan kata-kata tersebut. Kata-kata tersebut dikutip dari Insider sebenarnya diucapkan oleh sutradara dan penulis film “Get Out“, Jordan Peele, yang suara dan mulutnya telah disisipkan secara digital ke dalam video asli.

Teknologi itu yang kita sebut deepfake hari ini. Ia adalah bentuk AI yang digunakan untuk membuat atau menciptakan objek visual baik berbentuk foto maupun video dengan penambahan audio yang menyerupai objek asli.

Bagi para pengamat media, deepfake menghadirkan ancaman baru bagi masyarakat. Lewat deepfake yang saat ini bahkan bisa mudah diakses masyarakat luas, era disinformasi menjadi tidak terhindarkan. Akan ada banyak informasi berupa video atau gambar-gambar palsu dengan kemiripan sempurna beredar luas, sedangkan masyarakat belum punya kemampuan untuk membedakannya.

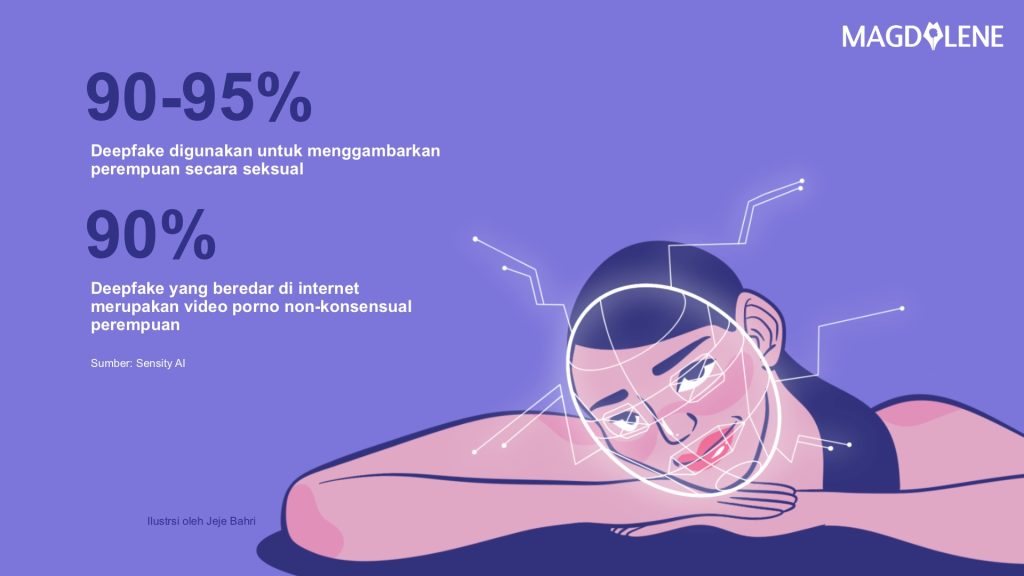

Namun, ancaman deepfake tidak berhenti sampai di sini saja. Sensity AI, sebuah perusahaan riset yang telah melacak video deepfake online sejak Desember 2018, secara konsisten menemukan bahwa antara 90 persen dan 95 persen deepfake nyatanya digunakan untuk menggambarkan perempuan secara seksual. Sebanyak 90 persen video deepfake yang beredar di internet adalah video porno non-konsensual perempuan atau disebut deepfake porn.

Sudah Terjadi di Indonesia

Deepfakes berawal dari pornografi, begitu kata Karen Hao jurnalis dan ilmuwan data Amerika. Dalam laporannya yang diterbitkan di MIT Technology Review. Pada bulan Desember 2017, Samantha Cole, reporter di Motherboard, menemukan bahwa seorang pengguna Reddit dengan nama “deepfakes” menggunakan teknik yang dikembangkan dan bersumber terbuka (open source) oleh para peneliti AI untuk menukar wajah perempuan selebriti ke dalam video porno.

Temuan itu Cole beritahukan kepada dunia. Ia mencoba memperingatkan pada masyarakat bahwa siapapun, terutama perempuan bisa jadi korban berikutnya. Buat para advokat yang bekerja sama dengan korban kekerasan, perkembangan teknologi ini sontak menimbulkan kekhawatiran.

“Sungguh alat yang sempurna bagi seseorang yang ingin menggunakan kekuasaan dan kendali atas korban. Ini (deepfake porn) jelas adalah masalah kekerasan terhadap perempuan,” kata Adam Dodge, pendiri EndTAB, sebuah organisasi nirlaba yang mengedukasi orang-orang tentang kekerasan yang dimungkinkan oleh teknologi.

Baca Juga: Belajar dari Kasus Gilang, Penggunaan UU ITE untuk Kekerasan Seksual Keliru

Dampak KBGO bagi Korban

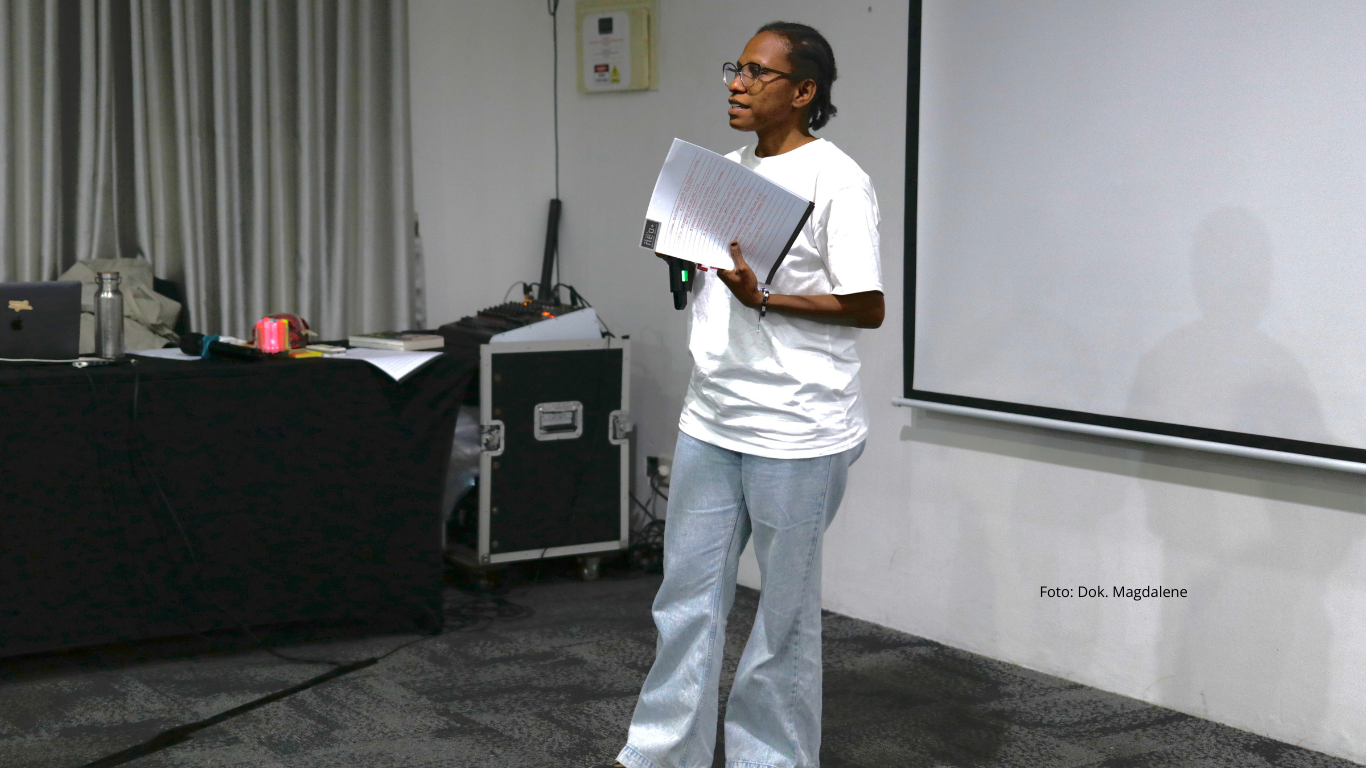

Selain Shinta, Dhyta Caturani, aktivis feminis dan pendiri Purple Code, sebuah lembaga swadaya yang berfokus pada interseksionalitas feminisme, hak asasi manusia (HAM), dan teknologi sempat berbagi ceritanya mendampingi penyintas deepfake kepada Magdalene.

Dalam wawancara daring pada awal September lalu, Dhyta menceritakan penyitas yang ia dampingi adalah perempuan dengan usia 26 tahun. Penyintas sebut saja Mawar pertama kali mengetahui dirinya adalah korban deepfake ketika melihat foto dirinya yang dimanipulasi tanpa busana tersebar di sebuah grup Facebook.

Beberapa informasi personalnya tersebar termasuk nomor telepon dan Mawar dibingkai seakan-akan sedang membuka Booking Online (BO). Mawar akhirnya banyak menerima pesan dan panggilan telepon bernada seksual dan fotonya tersebar sampai ke lingkungan kantor.

Dhyta menjelaskan deepfake sebagai bagian dari Kekerasan Berbasis Gender Online (KBGO), sama halnya seperti NCII, punya dampak yang besar pada korban. Berbeda dengan jenis kekerasan lain, karena kekerasan dalam KBGO dimungkinkan oleh teknologi maka pelaku tidak lagi tunggal.

“Awalnya bisa jadi pelakunya tunggal satu orang atau sekelompok orang, tapi ketika dia sudah menyebar, sudah terunggah di internet, maka pelakunya sudah tidak lagi tunggal. Orang bisa resharing, kemudian bisa menyimpannya, nanti bisa menyebarkannya kembali suatu saat nanti,” jelas Dhyta.

Penyebaran liar konten intim non-konsensual di internet inilah menurut Dhyta membuat tantangan yang dihadapi korban KBGO termasuk deepfake akan semakin berlipat. Foto-foto yang dimanipulasi bisa masuk ke ruang-ruang personalnya, seperti ruang pendidikan, kerja, dan keluarga.

Celakanya, ketika sudah masuk ke ruang-ruang ini berbagai hak dan akses dasar korban seperti hak dan akses atas pendidikan dan penghidupan dicabut paksa. Ini jelas mengakibatkan dampak psikologis yang besar pada korban karena lewat deepfake reputasi perempuan dirusak.

“Ketika reputasi seseorang, terutama seorang perempuan rusak, itu akan kemudian berdampak ke kehidupannya yang lain. Dia bisa kehilangan hak atas pendidikannya, bisa dikeluarkan dari sekolah atau kampusnya, atau bahkan kalau dia merasa malu, dia sendiri yang akan mengundurkan diri dari sekolah atau kampusnya, dia bisa kehilangan hak atas pekerjaan, karena bisa dipecat,” jelas Dhyta.

Dhyta pun menambahkan korban juga akan terkucilkan dari lingkungan terdekatnya, lingkungan keluarga, lingkungan masyarakat di sekitarnya juga, atau lingkungan pergaulannya. Ini karena menurut Dhyta kalau berbicara soal KBGO kita juga berbicara soal konteks norma sosial dan budaya di mana perempuan masih disekat-sekatan dalam batasan moralitas.

Hal inilah yang sayangnya terjadi pada Mawar. Dhyta bercerita ketika foto Mawar sudah tersebar di lingkungan kerja, bukannya mendapatkan dukungan dari teman-teman atau atasan di kantornya, Mawar justru dihakimi. Ia bahkan terancam dipecat.

“Foto itu beredar sampai ke tempat dia bekerja. Dia kemudian diancam untuk dipecat dari kantornya walaupun dia sudah berupaya berulang kali menyatakan bahwa itu bukan dirinya. Awalnya aku menawarkan, ‘Ayo kita mediasi aja’, aku yang akan berbicara. Tetapi dia sudah kepalang malu dan kepalang stres karena merasa tidak dipercaya, jadi dia akhirnya memutuskan untuk mengundurkan diri dari tempat kerjanya,” jelas Dhyta.

Amnesty International pada 2018 menyelidiki dampak KBGO terhadap perempuan di Twitter, khususnya dalam kaitannya dengan bagaimana mereka bertindak di dunia maya setelahnya. Menurut organisasi HAM non-pemerintah internasional ini, KBGO menciptakan apa yang mereka sebut sebagai “efek pembungkaman” atau silencing effect di mana perempuan merasa enggan untuk berpartisipasi di dunia maya.

Dhyta menjelaskan efek pembungkaman yang dialami korban deepfake membuat mereka melakukan swasensor. Sebuah proses memfilter, menyaring menyensor informasi yang diterima secara mandiri. Dalam swasensor, korban tidak lagi mau berbicara atau menggunakan media sosial sama sekali.

Kalau pun mereka masih menggunakannya, mereka akan menggunakannya dengan sangat hati-hati. Korban tidak lagi mengekspresikan diri atau mengungkapkan pendapat pribadinya lagi. Dalam berbagai kasus swasensor ini bisa mencapai level ekstrem di mana korban sama sekali tidak mau beraktivitas atau terlibat di dunia digital.

“Dengan cara hidup digital kita sekarang, orang yang tidak lagi mau menggunakan internet, atau salah satunya termasuk media sosial, maka dia akan kehilangan banyak kesempatan. Lihat saja sekarang semuanya kita dapatkan melalui internet, melalui sosial media. Bagaimana kita berkomunikasi dengan orang lain, berjejaring, mencari pekerjaan, mencari pengetahuan, informasi, itu juga semuanya melalui internet,” jelas Dhyta.

Hukum yang Perlu Disempurnakan

Dengan dampak besar yang dialami para korban deepfake, apakah hukum di Indonesia sudah cukup baik mengakomodir perlindungan bagi korban dan menjerat pelaku? Shevierra Danmadiyah, anggota dari TaskForce KBGO, sebuah jaringan kolektif yang berfokus pada pendampingan korban KBGO menerangkan kasus deepfake sebenarnya bisa diakomodir dengan dua undang-undang.

Pertama adalah Undang-Undang Nomor 11 Tahun 2008 tentang Informasi dan Transaksi Elektronik. Pelaku yang menyebarkan konten manipulasi yang bernuansa seksual bisa dijerat dengan pasal 27 ayat 1 yang berbunyi:

“Setiap orang dengan sengaja dan tanpa hak mendistribusikan dan/atau mentransmisikan dan/atau dapat membuat dapat diaksesnya informasi elektronik dan/atau dokumen elektronik, yang memiliki muatan yang melanggar kesusilaan”.

Tapi walaupun pelaku penyebaran bisa dijerat lewat pasal ini, menurut Shevi pasal ini sangat problematik karena ada kemungkinan korban justru dikriminalisasi. Adanya istilah kesusilaan dalam pasal ini menurut Shevi memberikan peluang buruk bagi korban untuk ditempatkan sebagai orang yang salah, dalam hal ini pelaku.

“Misalnya ketika kita merujuk kata asusila ini kan seakan-akan korban dan pelaku dalam posisi yang sama. Korban juga ditempatkan sebagai orang yang salah, yang dari segi sosial kemasyarakatan berbuat tidak baik,” kata Shevi.

Pernyataan Shevi bukan omong kosong belaka. Mengutip keterangan Erasmus A. T. Napitupulu Executive Director Institute for Criminal Justice Reform (ICJR) dalam diskusi publik ”Membedah Pembahasan Tertutup Revisi UU ITE 2.0” Senin (11/9/2023) lalu pengaturan norma kesusilaan yang diatur di dalam Pasal 27 Ayat (1) dan (3) UU ITE ini tidak jelas dan dimaknai luas. Utamanya dalam kerangka perbuatan “distribusi, transmisi dan membuat dapat diaksesnya” dokumen elektronik yang bermuatan kesusilaan dan penghinaan/pencemaran nama baik sangat rentan terhadap upaya perlindungan perempuan.

“Karena dalam KBGO kan kasusnya yang menyebar (konten intim) itu bukan korban, tapi orang lain. Harusnya UU ITE itu memberikan perlindungan pada korban jika integritas tubuhnya diserang. UU ITE juga harusnya melindungi orang yang memiliki konten pribadi karena itu forum privat. Baru masuk pidana itu kalau ke ruang publik disebar atau kemudian diperjualbelikan. Tapi kan secara substansi dan implementasinya (UU ITE) enggak mengakomodir ini,” kata Erasmus.

Menambahkan pernyataan Erasmus, resiko kriminalisasi terhadap korban KBGO yang melapor tercermin dalam hasil analisis LBH APIK terhadap 141 putusan pidana khusus terkait UU ITE pada 2020 – 2021. Hasil analisis yang tercantum dalam kajian soal dampak UU ITE pada korban KBGO yang terbit pada 2022 menunjukkan sebanyak 76 persen (104) menggunakan pasal 27 ayat (3) untuk mendakwa perempuan korban dengan dalih pencemaran nama baik.

Sedangkan, 24 persen (37) lainnya menggunakan pasal 27 ayat (1) tentang pendistribusian informasi elektronik dan/atau dokumen digital yang bermuatan asusila untuk mendakwa perempuan korban.

Potensi kriminalisasi atas pasal karet dan pemaknaan bias soal kesusilaan ini kemudian menurut Shevi bisa diatasi dengan menggunakan aturan yang lebih komprehensif, yaitu UU Undang-undang Nomor 12 Tahun 2022 tentang Tindak Pidana Kekerasan Seksual (UU TPKS) pasal 14 Ayat (1).

Shevi menerangkan pasal ini sudah cukup spesifik merujuk pada KBGO (dalam UU TPKS disebut sebagai kekerasan seksual berbasis elektronik atau KSBE). Pencantuman secara spesifik jenis kekerasan ini memungkinkan aparat penegak hukum untuk memidanakan seseorang yang mengambil dan menyebarkan konten tanpa persetujuan yang bersangkutan.

Pasal 14 Ayat (1) UU TPKS mengatur setiap orang yang tanpa hak:

a. melakukan perekaman dan/atau mengambil gambar atau tangkapan layar yang bermuatan seksual di luar kehendak atau tanpa persetujuan orang yang menjadi objek perekaman atau gambar atau tangkapan layar

b. mentransmisikan informasi elektronik dan/atau dokumen elektronik yang bermuatan seksual di luar kehendak penerima yang ditujukan terhadap keinginan seksual; dan/atau

c. melakukan penguntitan dan/atau pelacakan menggunakan sistem elektronik terhadap orang yang menjadi obyek dalam informasi/dokumen elektronik untuk tujuan seksual.”

Menurut pasal tersebut, pelaku dapat dijerat pidana penjara paling lama empat tahun dan/atau denda paling banyak Rp. 200.000.000,00 (dua ratus juta rupiah), atas kekerasan seksual berbasis elektronik.

Namun adanya UU TPKS dengan pasal spesifik yang mengacu pada jenis kekerasan yaitu KBGO bukan berarti korban lalu bisa dengan mudah mendapatkan keadilan. Shevi yang juga seorang peneliti di bidang hukum membaca beberapa putusan pengadilan terkait kasus KBGO. Dalam analisisnya, Shevi menemukan bagaimana dalam kasus KBGO, aparat penegak hukum kerap kali berakhir menjatuhkan dakwaan pada pelaku berdasarkan pasal-pasal karet UU ITE (pasal 27 ayat (1), pasal 27 ayat (4) jo. Pasal 45 ayat (4) atau Pasal 29 jo).

Ketidakberhasilan aparat penegak hukum, khususnya jaksa dan hakim, dalam melihat dimensi KBGO pada beberapa putusan yang ia baca memperlihatkan bagaimana mereka tidak memiliki perspektif korban. Fokus aparat penegak hukum hanya sampai pada “penyebaran foto/video yang bermuatan asusila,” padahal apa yang dialami oleh korban adalah kekerasan seksual. Dengan mensimplifikasi perkara kaya Shevi maka pertimbangan-pertimbangan terkait gender, relasi kuasa, dan persetujuan (consent) menjadi hilang.

“Tidak pernah (aparat penegak hukum) meng-acknowledge bahwa ini adalah KBGO. Aspek atau variabel terkait dengan kekerasan seksual justru nggak pernah dilihat. Jadi yang dilihat adalah oke ada konten bermuatan ini yang tertransfer dan itu tidak baik secara publik jadi orang yang ada di dalamnya ya itu bersalah,” kata Shevi.

Ucapan Shevi pun setidaknya beresonansi dengan pengalaman pribadi Shinta. Dua hari setelah ia tau foto dan informasinya tersebar, ia melapor ke polisi. Sayangnya, bukannya diproses dengan menggunakan UU TPKS, polisi justru menggunakan UU ITE. Kasus Shinta pun mandek. Ia takut kasusnya nanti justru akan balik mengkriminalisasi. Celakanya lagi karena menggunakan UU ITE, Shinta juga tidak mendapatkan jaminan atau bantuan psikologis dari negara atas kasus yang membuatnya trauma.

“Mereka dalihnya ‘Kamu kan enggak punya foto nude kan, ini pencemaran nama baik’. The way they respond the case pas aku bilang ini sindikat karena complicated sistemnya dan masuk jenis kekerasan seksual, mereka bilang ‘Kamu yakin bukan temen yang jahatin kamu aja kali? Dicekin dari instagram kamu’. Jadinya based on that, hands up aja kalau mau depend ke polisi,” kata Shinta.

Baca Juga: SKB UU ITE Bawa Kemajuan, Tapi Revisi UU Tetap Diperlukan

Apa yang Bisa Dilakukan?

Minimnya pemahaman aparat penegak hukum soal KBGO memang jadi batu sandungan bagi korban untuk mencari dan mendapatkan keadilan. Shevi pun mengutip teori Lawrence M. Friedman, profesor hukum Amerika Serikat. Friedman menyatakan bahwa untuk memiliki sebuah hukum yang baik setidaknya harus ada aspek yang harus dipenuhi. The structure of law (struktur hukum), the substance of law (substansi hukum), and the legal culture (budaya hukum).

Secara struktur, Indonesia punya aparat penegak hukum yang bekerja untuk memberikan keadilan dan perlindungan bagi korban. Tetapi karena kesadaran aparat penegak hukum masih rendah menurut Shevi perlu ada peningkatan kapasitas yang baik dan bagus terkait pemahaman KBGO dan sensitifitas gender secara keseluruhan pada aparat penegak hukum.

“Aparat penegak hukum perlu memahami bagaimana kejahatan berkembang dan produk hukum kita masih belum bisa mengakomodir kebutuhan korban karena masih maskulin,” kata Shevi.

Selanjutnya untuk substansi hukum, Shevi mengatakan membuat undang-undang baru yang lebih spesifik bukan jadi jawaban karena Indonesia kata Shevi sudah overregulated. Hal yang justru dibutuhkan adalah aturan turunan yang lebih teknis sebagai rencana tindak lanjut dalam memproses kasus kekerasan seksual dalam hal ini KBGO. Hal ini karena UU TPKS sendiri masih belum mempunyai aturan turunan sehingga membuat implementasinya terhambat.

Terakhir, budaya hukum. Melihat situasi masyarakat di Indonesia yang masih cenderung menyalahkan korban kekerasan seksual maka Shevi mendorong agar pemerintah punya program-program khusus tersendiri untuk membangun kesadaran dan sensitivitas masyarakat terhadap KBGO.

“Kemendikbud atau mungkin ada satu inisiasi menggaungkan peraturan secara internal dan kampanye terkait KBGO. Ini perlu disentuh pemerintah,” katanya.

Menambahkan pernyataan Shevi, Dhyta mengatakan selain menyempurnakan hukum lewat tiga aspek tadi satu hal lain yang perlu dilakukan adalah mendorong pertanggung jawaban platform media digital.

Dengan tidak terhindarkannya teknologi deepfake yang terus disempurnakan oleh para peneliti AI, platform digital punya tanggung jawab besar dalam menghentikan penyebaran dan menghapus konten-konten intim non-konsensual. Hal ini tak lain karena platform digital adalah gerbang pertama penyebaran dan tempat penyimpanan konten-konten ini.

“Bagaimana kecepatan respon mereka apabila ada laporan-laporan seperti ini (deepfake). Itu penting. Laporan kecepatan respon ini mensyaratkan bahwa mereka memperlakukan kasus-kasus pelanggaran tertentu itu sebagai prioritas,” kata Dhyta.

Beberapa platform digital seperti Facebook, TikTok, dan Instagram beruntungnya sudah menjadi partner dari StopNCII.org, sebuah proyek yang dioperasikan oleh Revenge Porn Helpline yang menawarkan teknologi inovatif untuk membantu orang agar tidak menjadi korban dengan mencegah berbagi gambar intim tertentu. Namun, inisiasi baik menurut Dhyta harus diperluas.

“Kalau berkerjasama cuma dengan satu, dua, atau tiga saja sebenarnya nggak cukup. Tapi dengan semua (platform digital),” katanya.

Terakhir, tak kalah pentingnya bagi Dhyta untuk juga ikut memberikan kritik membangun pada insiasi baik ini. Sebagai seseorang yang bergelut di bidang gender dan teknologi, Dhyta menilai untuk menilai efektifitas dan apakah kinerja dari StopNCII sudah baik atau belum diperlukan audit independen.

“Ini jatuhnya tools kan ya. Bahwa apa yang mereka bilang dan mereka janjikan itu benar adanya dibutuhkan audit secara independen. Mereka kan mengklaim bahwa mereka tidak menyimpan foto yang kita kirim. Itu harus dibuktikan dengan audit independen. Bukan yang dibayar oleh perusahaan atau organisasi tersebut maka we can use it dengan caution, dengan tetap hati-hati, dengan kewaspadaan,” tutup Dhyta.

Ilustrasi oleh: Karina Tungari dan Jeje Bahri

Liputan ini merupakan kerja sama dengan Meedan.