Polaroid AI Bahayakan Perempuan dan Normalisasi Kekerasan Digital

Riri, 32, sudah lama mengidolakan Gawin Caskey, aktor sekaligus penyanyi asal Thailand. Saat media sosial diramaikan tren foto polaroid AI bersama idola, ia pun ikut penasaran. “Aku ikutan tren ini ya buat senang-senang aja,” kata Riri sambil menunjukkan hasil polaroid digital yang kini menjadi latar ponselnya. Dalam foto itu, ia tampak merangkul aktor pujaannya seolah mereka benar-benar pasangan.

Ternyata, apa yang dilakukan Riri bukan hal baru. Media sosial, khususnya X dan Instagram, dipenuhi unggahan pengguna yang mencoba membuat polaroid AI bersama idola masing-masing.

Tren ini muncul usai Google merilis Gemini 2.5 Flash, model Generative AI (GenAI) yang direkomendasikan untuk membuat polaroid realistis. Pengguna cukup mengunggah foto diri dan idola, lalu memasukkan prompt khusus.

Dalam hitungan detik, gambar polaroid bergaya retro yang menampilkan pengguna bersama figur publik, aktor, atau atlet terkenal bisa tercipta dengan sempurna. Beberapa pemain Tim Nasional Indonesia pun menjadi sasaran tren ini. Alih-alih merasa tersanjung, mereka justru mengaku risih ketika mengetahui foto mereka diedit.

Pemain Persatuan Sepak Bola Jakarta (Persija) Rizky Ridho menyatakan ketidaknyamanannya setelah muncul foto editan AI yang menampilkan ia dalam pose tak pantas dengan perempuan berhijab. Melalui unggahan di akun Instagram pribadi, ia meminta agar penggemar lebih bijak dan tidak melewati batas.

“Teman-teman minta tolong lebih sopan lagi ya, tidak perlu diedit seperti ini,” tulis Rizky melalui Instagram Story.

Hal serupa dialami Justin Hubner. Ia bereaksi keras setelah editan polaroid AI menampilkannya seolah berciuman dengan perempuan. Dalam unggahannya di Instagram Story, Hubner mengingatkan editan semacam itu bisa menimbulkan masalah, terutama karena menyangkut perasaan orang terdekatnya.

Baca Juga: 5 Hal yang Perlu Diketahui Soal Teknologi Deepfake

Kekerasan Digital yang Berkamuflase jadi Tren

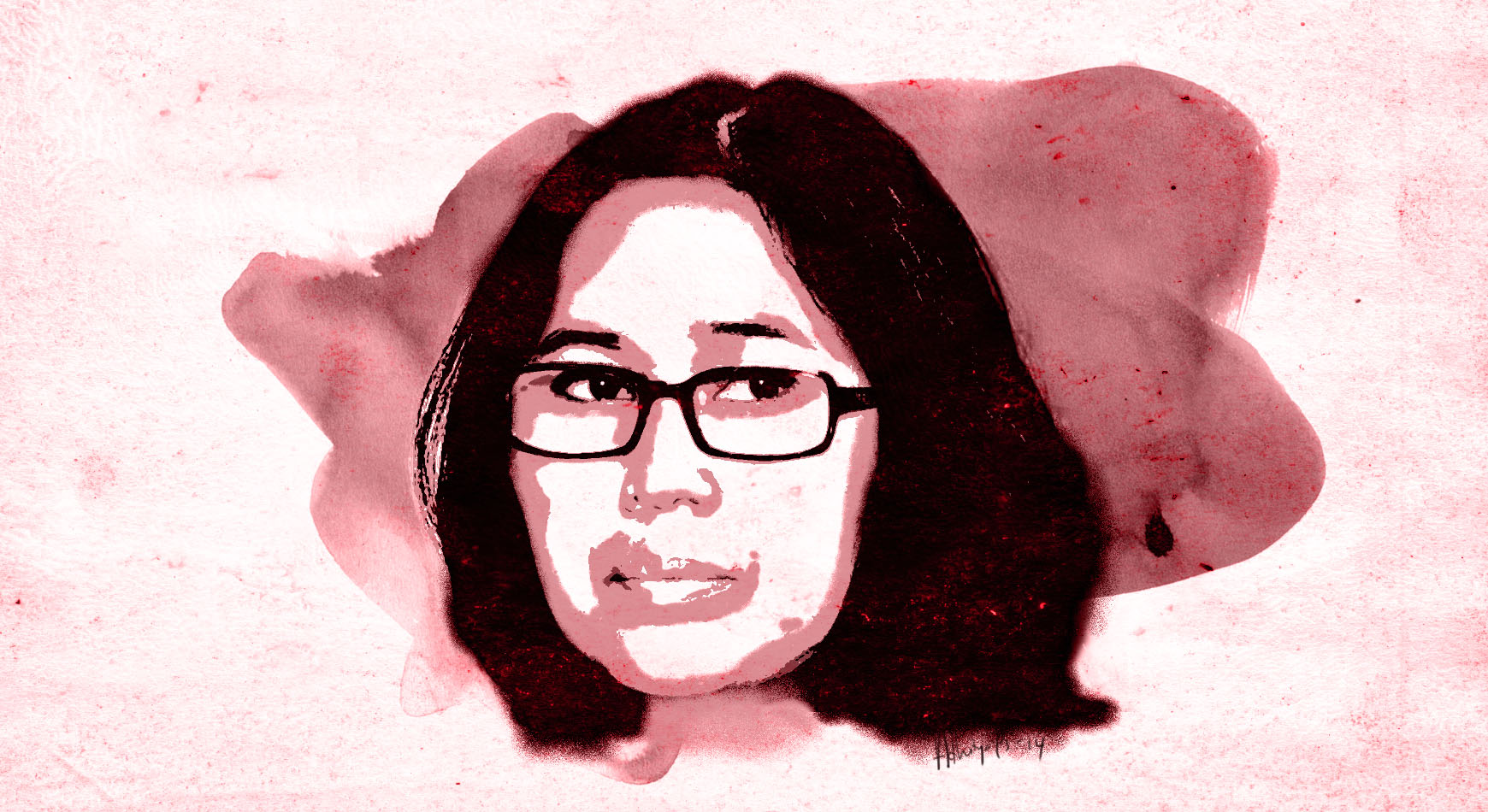

Bagi banyak orang, tren ini terlihat sebagai hiburan semata. Namun persoalannya tidak sesederhana itu. Apa yang bagi penggemar terasa sepele, bagi mereka yang fotonya dipakai bisa menjadi pelanggaran. Alia Yofira Karunian, Peneliti Gender dan Kebijakan terkait Teknologi dari PurpleCode Collective, menekankan persetujuan jadi kunci dalam setiap penggunaan gambar seseorang.

“Secara umum, persetujuan diperlukan untuk penggunaan gambar, suara, atau penampilan seseorang, terutama dalam konteks komersial atau publik, namun batasan ini kabur seiring dengan perkembangan teknologi terutama Generative AI,” ungkap Alia dalam wawancara bersama Magdalene (15/9).

Apa yang diungkapkan oleh Alia sempat dibahas dalam jurnal yang diterbitkan Universitas Cornell. Berjudul “Can AI be Consentful?” (2025) jurnal ini menggarisbawahi nihilnya kerangka hukum dan etika tradisional dalam GenAI. Meskipun seseorang mungkin menyetujui penggunaan data mereka untuk pelatihan AI, mereka tidak dapat secara bermakna menyetujui seluruh kemungkinan output, penggunaan kembali, distribusi, atau efek penerapan hasil tersebut. Kemungkinan paling berbahaya dari GenAI ini pun makin terasa karena seseorang tanpa konsen bisa leluasa tanpa regulasi yang jelas dan mengikat memasukan data orang lain ke dalam sistem pelatihan AI.

Penelitian ini mengidentifikasi tiga tantangan utama terkait GenAI, yakni scope problem (cakupan penggunaan data yang tidak jelas), temporality problem (konsekuensi penggunaan di masa depan sulit diperkirakan), dan autonomy trap (jebakan di mana individu merasa bebas memilih padahal persetujuan sangat terbatas). Tantangan-tantangan ini menciptakan consent gap atau jurang persetujuan dalam ekosistem AI, yang berpotensi menimbulkan ruang baru bagi kekerasan digital.

Dalam kasus polaroid AI, bentuk kekerasan tersebut beririsan dengan pelecehan seksual daring (online sexual harassment). Masalahnya bukan sekadar hilangnya konsen, tapi individu yang diedit sebagai objek fantasi seksual, dicerabut dari identitas dan otonominya. Tren semacam ini berisiko mengaburkan batas privasi dan kontrol atas citra diri, yang bisa menormalisasi siklus kekerasan berbasis gender secara luas.

“Jadinya tren seperti ini bakal menormalisasi tindakan tanpa persetujuan dan mengabaikan prinsip dasar kebebasan memilih dan kontrol diri atas representasi tubuh di ruang digital,” sebut Alia.

Baca Juga: Ancaman Deepfake: KBGO dan Gerak Perempuan yang Makin Rentan

GenAI dan Kerentanan Perempuan

Perkembangan teknologi AI membawa risiko tambahan khususnya bagi perempuan. Data yang diunggah ke sistem AI tidak pernah benar-benar hilang. Begitu masuk, data tersebut bisa tersimpan selamanya dan digunakan dalam sistem pembelajaran AI tanpa persetujuan pengguna.

Alia menjelaskan, GenAI dalam tren polaroid atau sebelumnya Ghibli style umumnya menggunakan teknologi subset dari machine learning yang dikenal sebagai deep learning. Sistem ini dapat menghasilkan konten baru—paragraf panjang, cerita, gambar berkualitas tinggi, video, hingga audio yang realistis—karena diprogram untuk terus belajar mengenali pola dari training data yang ada.

“Karena sifatnya ini, ada kemungkinan besar bahkan developer-nya pun enggak tahu data ini ketika sudah dimasukkan bakal diproses seperti apa di dalam sistem AI-nya,” jelasnya.

Semakin bermasalah, teknologi AI yang tersedia untuk publik dan tidak terikat regulasi jelas banyak digunakan untuk memproses foto intim non-konsensual, bahkan menjadi industri bernilai besar. Analisis dari Indicator—publikasi yang menyelidiki penipuan digital—menemukan 85 situs web ‘nudify’ dan ‘undress’ yang memungkinkan pengguna mengunggah foto untuk menelanjangi perempuan menggunakan GenAI. Per Juli lalu, sebagian besar situs ini bergantung pada layanan Google, Amazon, dan Cloudflare, dengan rata-rata gabungan 18,5 juta pengunjung per bulan selama enam bulan terakhir dan secara kolektif menghasilkan hingga 36 juta US dollar (Rp593 triliun) per tahun.

Temuan Indicator menambah daftar panjang permasalahan soal manipulasi foto atau video intim non-konsensual atau yang biasa disebut sebagai deepfake porn. Menurut Sensity AI, perusahaan riset antara 90 persen dan 95 persen deepfake yang dihasilkan GenAI yang beredar di internet nyatanya digunakan untuk menggambarkan perempuan secara seksual.

Hal ini, menurut penelitian yang diterbitkan jurnal hukum Universitas Brigham Young, Amerika Serikat, tidak lepas dari program deepfake yang memang dirancang khusus untuk hanya memungkinkan pembuatan visual perempuan. Salah satu aplikasi populer, DeepNude, misalnya, tidak akan bekerja dengan baik jika diberikan gambar laki-laki; ia hanya menempelkan vulva di atas genitalia laki-laki. Kondisi ini menunjukkan betapa bias terhadap objekifikasi perempuan meresap ke dalam GenAI yang tersedia luas dan bisa diakses publik tanpa konsekuensi hukum yang jelas.

Baca Juga: Magdalene Primer: UU ITE Kriminalisasi Perempuan Korban Pelecehan Seksual

Saatnya Berbenah

Menghadapi kompleksitas ini, peran negara tidak bisa diabaikan. Alia menekankan, persoalan GenAI bukan masalah individu semata, melainkan struktural, karena berkaitan erat dengan minimnya regulasi yang mengikat dan peran edukasi negara yang masih terbatas.

“Di sisi lain perkembangan teknologi terus berjalan, risiko terkait AI makin banyak. Seharusnya penting buat negara hadir misalnya masukin risiko tentang AI dalam kurikulum literasi digital,” sebut Alia.

Di tengah situasi ini, media seharusnya mengambil bagian dalam mengedukasi publik, bukan sekadar ikut tren. Faktanya, di tengah gempuran tren GenAI, baik polaroid maupun Ghibli style yang viral awal tahun ini, banyak media di Indonesia justru meniru saja. Bahkan mereka ramai-ramai memberikan panduan penggunaan GenAI, alih-alih mengkritisi implikasi di balik tren tersebut.

Karena itu, kata Alia, media sudah sepatutnya mulai berbenah. Ia mengingatkan agar jurnalis meliput berita lebih komprehensif ke depannya.

“Mereka harus mempertanyakan kembali apa yang sedang beredar, memberikan informasi terkait risiko-risiko di balik perkembangan AI ini, sehingga masyarakat bisa membuat keputusan yang lebih terinformasi,” tuturnya.

Selain itu, NGO juga penting ambil peran dalam mendorong akuntabilitas negara misalnya dengan ikut serta dalam konsultasi publik yang biasanya dilakukan berbagai kementerian, tidak terkecuali Kementerian Komunikasi dan Digital (Komdigi). Dalam siaran pers Komdigi pada awal Agustus lalu, mereka membuka konsultasi publik terhadap Buku Putih dan Konsep Pedoman Etika Kecerdasan Artifisial.

Buku Putih Peta Jalan Kecerdasan Artifisial Nasional merupakan keluaran Gugus Tugas Peta Jalan KA Indonesia yang beranggotakan 443 orang dari pemerintah, akademisi, industri, komunitas, dan media. Sementara Pedoman Etika Kecerdasan Artifisial bertujuan memperkuat kebijakan etika KA yang saat ini tercantum dalam Surat Edaran Menkominfo Nomor 9 Tahun 2023.

Tanggapan publik terhadap kedua dokumen ini dibuka hingga (22/8) melalui email Komdigi. PurpleCode Collective menjadi salah satu pihak yang memberikan masukan terkait penggunaan AI berbasis HAM dan etika, menyoroti kerentanan baru bagi kelompok termarjinalkan seperti perempuan, anak, dan penyandang disabilitas. Masukan ini ditujukan agar pemerintah memahami bahwa praktik AI saat ini banyak melenceng dari prinsip etika berbasis HAM.

Alia berharap pemerintah lebih proaktif mengatur AI, termasuk memastikan training data mengikuti prinsip perlindungan data pribadi, menyiapkan mekanisme pengawasan untuk AI berisiko tinggi, dan melarang tipe AI yang tidak dapat ditoleransi.

Beberapa negara sudah memberi contoh. Di Denmark, setiap warga memiliki hak cipta atas wajah dan tubuhnya. Menteri Kebudayaan Jakob Engel-Schmidt menyebut peraturan ini sebagai perlindungan terhadap potensi penyalahgunaan AI, tulis The Guardian. Uni Eropa pun mengatur AI ketat lewat General Data Protection Regulation (GDPR), termasuk memberi opsi penghapusan data jika diproses tanpa persetujuan.

“Pemerintah sudah bilang akan melakukan pengaturan terhadap ini (AI) secara lebih holistik. Jadi ini menjadi salah satu momentum juga untuk kita bersama untuk terus mengawal agar ke depannya AI digunakan dengan lebih bertanggungj awab,” tutup Alia.